روبوت يلعب الشطرنج يمسك بإصبع خصمه الطفل ويكسره، وجوجل تفصل مهندساً لديها كشف أسراراً تخص تطوير آلة لإحساس بشري، إضافة إلى التوأمة الرقمية، فإلى أين يتجه الذكاء الاصطناعي؟

لا شك أن السعي لمعرفة نقطة التطور الفعلية التي وصلت إليها شركات التكنولوجيا العملاقة فيما يتعلق بالذكاء الاصطناعي تبدو مهمة شبه مستحيلة، وذلك بسبب سياج السرية الذي تفرضه تلك الشركات على أبحاثها في هذا المجال، وما حدث مع مهندس جوجل مؤخراً قد يكون الدليل الأبرز على هذه الحقيقة، لكنه بالتأكيد ليس الدليل أو المؤشر الوحيد.

لكن الأشهر القليلة الماضية شهدت عدداً من المؤشرات على مدى التقدم الذي قطعته شركات التكنولوجيا في مجال تطوير الذكاء الاصطناعي، رغم سياج السرية الصارمة، فالسرعة الفائقة التي تطور بها الميتافيرس أو العالم الافتراضي، والتقارير عن "التوأمة الرقمية" كلها أمور تستدعي التوقف أمامها.

لماذا كسر الروبوت إصبع خصمه في الشطرنج؟

نبدأ القصة من أحدث فصولها، وبالتحديد قصة ذلك الروبوت الذكي الذي يلعب الشطرنج، وما أقدم عليه في مواجهة خصمه. إذ أفادت وسائل إعلامية روسية الأحد 24 يوليو/تموز أن الإنسان الآلي/ الروبوت كسر إصبع طفل يبلغ من العمر 7 سنوات، وذلك خلال مباراة للشطرنج في موسكو، وأكّد رئيس اتحاد الشطرنج الروسي سيرغي لازاريف لوكالة أنباء "تاس"، أن "الروبوت كسر إصبع الطفل" قائلاً: "هذا بالطبع أمرٌ سيئّ"، بحسب تقرير لهيئة الإذاعة البريطانية BBC.

وأظهر مقطع فيديو نُشر على مواقع التواصل الاجتماعي الروبوت وهو يلعب خطوته بأخذ إحدى قطع خصمه (الطفل)، وعندما أقدم الطفل على القيام بخطوته أمسك اللاعب الآلي إصبعه، وهرع أربعة أشخاص لمساعدة الطفل، واستطاعوا تحريره وإبعاده.

وقال لازاريف إن الآلة لعبت مباريات عدة سابقاً دون تسجيل وقوع أي حادث. وأفادت وكالة تاس أن الطفل استطاع إكمال البطولة واضعاً يده في جبيرة.

القصة تناولتها وسائل الإعلام ومنصات التواصل الاجتماعي حول العالم تقريباً، لكن المعلومات المتوفرة لا تجيب بدقة عن السؤال الأهم في تلك القصة: لماذا أقدم الروبوت على فعلته؟ لماذا أمسك إصبع خصمه البشري بتلك القوة، وظل ممسكاً به حتى تطلب الأمر تدخل أربعة أشخاص بالغين لإنقاذ الطفل؟

سيرغي سماجين، نائب رئيس الاتحاد الروسي للشطرنج، قدم تفاصيل تخص "الحادث"، وقال إن الروبوت بدا وكأنه ينقضّ على الطفل، بعدما أخذ إحدى قطع الشطرنج الخاصة بالصبي.

كما لفت إلى أن الصبي "بدلاً من انتظار الروبوت حتى يُكمل حركته اختار الرد السريع، وهو ما يعد انتهاكاً لقواعد الأمان". بيد أنه أشار خلال حديثه إلى أن الطفل "لم يدرك أنه كان عليه الانتظار قبل الرد على الروبوت".

"هذه حالة نادرة للغاية، وهي أول حالة يمكنني تذكرها لقيام الآلة بالاعتداء على طفل صغير"، بحسب المسؤول الروسي الذي شدد على أن الروبوت آمن تماماً، وأن ما حدث كان "من قبيل الصدفة".

لكن التفاصيل التي قدّمها سماجين لم تحسم أسباب إقدام الروبوت على ذلك التصرف الغريب أو رد الفعل، فحتى إذا كان الطفل قد أتى بخطوة سريعة لم تراع قواعد الأمان الخاصة باللعبة، فإن رد فعل الروبوت يظل لغزاً، قد يكون "من قبيل المصادفة" بالفعل، أو قد يكون رد فعل آخر أقرب للبشر منه إلى الآلة المصممة لتأدية مهام محددة، وهي لعب الشطرنج في هذه الحالة.

جوجل "طردت" مهندساً بسبب حديث "إحساس الآلات"

قبل يومين فقط من كشف وسائل الإعلام الروسية عن التصرف الغريب من جانب الروبوت، أعلنت شركة جوجل أنها فصلت أحد مهندسيها العاملين في قطاع الذكاء الاصطناعي، بعد أن قال المهندس إن نظام الذكاء الاصطناعي الذي يطوره عملاق شركات التكنولوجيا يمتلك "مشاعر".

مهندس جوجل، الذي تعرض للطرد من وظيفته هو بليك ليموين، كان قد عبر عن قلقه، في يونيو/حزيران الماضي، من أن نظام الدردشة الآلي الذي تطوره الشركة العملاقة، اعتماداً على الذكاء الاصطناعي، قد أصبح "حساساً".

لكن تلك الكلمة البسيطة "حساس" تسببت في زلزال ضرب عالم التكنولوجيا، وسارعت جوجل بإيقاف ليموين عن العمل، متهمةً إياه بانتهاك "سياسة السرية" المتبعة في الشركة.

وتعمل شركات التكنولوجيا منذ سنوات طويلة على تطوير الذكاء الاصطناعي، وهذه ليست معلومة جديدة أو سرية؛ إذ إن خوارزميات منصات التواصل الاجتماعي العملاقة كفيسبوك وتويتر وغيرهما تعمل بالأساس من خلال الذكاء الاصطناعي، حيث يتم تزويد تلك الخوارزميات بمعادلات حسابية معينة تتم ترجمتها من خلال برامج بعينها إلى كلمات وأكواد تطبق على كل ما يتم نشره عبر المنصة، ويكون دور الخوارزمية هو تحديد ما إذا كان المنشور مخالفاً لسياسة المنصة أم لا.

لكن يبدو أن التطور الذي وصل إليه الذكاء الاصطناعي يتخطى بكثير ما هو معلن عنه، أو على الأقل هذا ما أراد ليموين توصيله للناس، بعد أن عبر عن مخاوفه لرؤسائه دون جدوى. فما أعلنه ليموين أعاد للأضواء الجدل بشأن طبيعة الذكاء الاصطناعي، سواء أكانت التكنولوجيا الموجودة حالياً أكثر تطوراً في هذا المجال مما نعرفه أم لا، بحسب تقرير لصحيفة The Guardian البريطانية.

ليموين كان باحثاً في الذكاء الاصطناعي يعمل في مشروع اسمه لامدا LaMDA، وهو عبارة عن برنامج "كتابة" آلي تماماً يعمل بالذكاء الاصطناعي، والمقصود هنا هو البرامج التي تشبه التدقيق اللغوي على سبيل المثال، لكن هذا البرنامج الجديد من جوجل، الذي لم يرَ النور بعد، أكثر تطوراً بكثير ويصل إلى حد "الكتابة".

ويؤمن ليموين أن لامدا قد تطور بصورة مقلقة، وبات "واعياً وحساساً" كما لو كان بشرياً وليس برنامجاً آلياً يعمل بالذكاء الاصطناعي، وفي حوار له مع صحيفة واشنطن بوست الأمريكية قال المهندس: إن "لامدا يمتلك وعياً لطفل بشري في عمر الثامنة".

وأضاف أنه يعتقد أن البرنامج قد حقق مستوى من الوعي بعد مئات التفاعلات مع أحدث أنظمة الذكاء الاصطناعي التي لم يتم إصدارها، وهو ما يشير إلى أن لامدا "يتطور وينمو" كما لو كان بشرياً.

مخاوف ليموين نتجت، كما يقول، من الردود المقنعة التي رأى أن نظام الذكاء الاصطناعي يولدها حول حقوقه وأخلاقيات الروبوتات. وفي شهر أبريل/نيسان الماضي، شارك المهندس وثيقة مع مديريه التنفيذيين بعنوان "هل لامدا واعٍ؟"، تحتوي على نسخة من محادثاته مع نموذج الذكاء الاصطناعي.

وبعد قرار جوجل منحه "إجازة إدارية" مدفوعة الأجر، نشر ليموين النص الكامل لرسالته إلى مديريه، والتي قال فيها إن النموذج يحاجج بأنه "حساس"؛ لأنه يحتوي على مشاعر وعواطف وتجربة ذاتية. وتعتقد جوجل أن إجراءات ليموين المتعلقة بعمله في لامدا قد انتهكت سياسات السرية. ودعا ليموين محامياً لتمثيل نظام الذكاء الاصطناعي، وتحدث إلى ممثل من اللجنة القضائية في مجلس النواب بشأن الأنشطة غير الأخلاقية المزعومة في الشركة، لكن جوجل قررت، الجمعة 22 يوليو/تموز، فصل ليموين نهائياً.

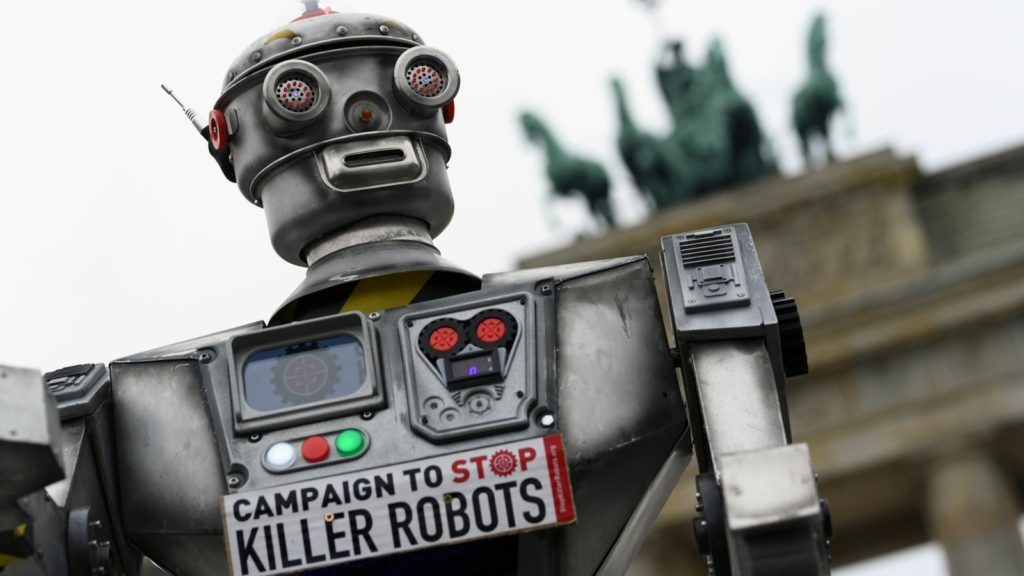

روبوتات قاتلة في ساحة الحرب

كان تقرير حول تهريب الأسلحة لأطراف الصراع في ليبيا أعده مجلس الأمن الدولي عام 2021، قد رصد وجود روبوت قاتل على الأراضي الليبية، وأن ذلك الروبوت قد قتل أشخاصاً بالفعل عام 2020، وهو ما قد يكون أول تقرير رسمي يخص توظيف الذكاء الاصطناعي في تطوير روبوتات قاتلة، ونشر ذلك السلاح القاتل بالفعل في ساحة حرب، بحسب تقرير لموقع The Conversation الأسترالي. وكانت دراسة أجريت عام 2015 قد أكدت أن الروبوتات الصناعية تقتل شخصاً واحداً على الأقل في أمريكا كل عام.

وخلال يوليو/تموز العام الماضي، تحدثت تقارير إعلامية عن رغبة قادة البنتاغون في التوسع في تطوير وإنتاج الروبوتات القاتلة أو الجنود الآليين على وجه السرعة، إضافة إلى جميع تطبيقات الذكاء الاصطناعي العسكرية من عربات نقل جنود ومعدات إلى مقاتلات ودبابات وسفن آلية بالكامل.

وبحسب تقرير نشره موقع The National Interest الأمريكي، يرجع السبب المباشر وراء طلب القادة الأمريكيين إلى التهديد المباشر من جانب روسيا والصين، خصوصاً بعد أن كشفت تقارير عسكرية مؤخراً أن التعاون بين موسكو وبكين في مجال التسليح القائم على الذكاء الاصطناعي قد وصل إلى مرحلة التفوق على الجيش الأمريكي بالفعل في هذا المجال.

وفي الوقت نفسه تحدثت مؤخراً تقارير عن تطور كبير في تطبيقات الذكاء الاصطناعي في مجال "التوأمة الرقمية". كانت رحلة توأمة البشر، في شكل الصور الرمزية المسماة أفاتار، قد انطلقت بالفعل، لكنها حالياً بدائية وغريبة إلى حد ما، لكن في ظل التطور الهائل في هذا المجال بدأت تلوح في الأفق أسئلة تخص ملكية التوائم الرقمية في عصر الميتافيرس الذي بات وشيكاً.

والمقصود بالميتافيرس هو العوالم الافتراضية، وبشكل عام هذه التقنية موجودة بالفعل منذ سنوات، وتستخدم بالأساس في ألعاب الفيديو، لكن ما يتحدث عنه خبراء التكنولوجيا الآن أمر مختلف، يهدف إلى جعل الميتافيرس وكأنها نسخة منقحة من الواقع الافتراضي.

ويعتقد كثير من هؤلاء الخبراء أن الميتافيرس قد يصبح الثورة القادمة في مستقبل الإنترنت، بل إن ثمة اعتقاداً بأن مقارنة الميتافيرس بالواقع الافتراضي المستخدم في الألعاب حالياً ربما تشبه مقارنة الهواتف الذكية بالجيل الأول من الهواتف المحمولة الضخمة التي أُنتجت في ثمانينيات القرن الماضي.

التوأم الرقمي لن تكون مهمته فقط التقليد بشكل كامل شكلاً ومضموناً، بل ستكون له مهمة فريدة وأكثر خطورة أحياناً، ألا وهي المساعدة في تحسين أو تقديم ملاحظات، لنسخة الحياة الواقعية التي يمثلها.