ثورة الروبوتات على البشر قد تكون أقرب إلينا مما نتوقع، وهذا ما يظهر من حربي أوكرانيا وغزة الدمويتين، وبات التساؤل بشأن احتمال سيطرة الروبوتات على العالم، ليس مجرد فكرة سخيفة تتكرر في أفلام الخيال العلمي، بل خطر حقيقي يراه كثير من الخبراء ماثلاً بجدية.

فلقد أظهرت حربا أوكرانيا وغزة أن النسخ الأولى من الطائرات المسيّرة التي تعادل "الروبوتات القاتلة" قد وصلت إلى ساحة المعركة، وأثبتت كونها أسلحةً مدمرة، وهذا قد يعني أن الجيوش سوف تستثمر فيها أكثر وستتحول تدريجياً إلى عماد الجيوش الحديثة.

حتى الآن ما زالت الأسلحة المسيرة خاضعة لتحكم البشر بنسبة كبيرة، غير أن الأمر المثير للقلق أن الوضع الحالي يدعو لتصور الحال إذا حدث العكس، وبات عالم الحروب يخضع فيه البشر لسيطرة تلك المسيّرات الجوية (أو نسخها المكافئة البرية والبحرية)، حسبما ورد في تقرير لموقع Responsible Statecraft الأمريكي.

وقال كاتب التقرير: "لا شك أننا سنحيا في كوكب مختلفٍ بدرجة مدمرة، وبأسلوب قد نعجز عن تصوّره حتى في يومنا هذا".

يحذر الكاتب من أن سيناريو سيطرة الروبوتات على العالم وتمردها على صناعها ليس محض خيال بعيد عن الواقع، وذلك بالنظر إلى العمل الذي بدأته القوى الكبرى على الذكاء الاصطناعي والأسلحة الآلية أو الروبوتية بالفعل.

وعرض الكاتب لبعض التفاصيل الخطيرة لهذا العالم الغامض للأسلحة الذكية وعرض لبعض الأفكار والمشروعات التي تنذر بمسقبل مريع للحروب قد يؤدي إلى سيطرة الروبوتات على العالم أو حتى ما هو أسوأ من ذلك.

الجيش الأمريكي يريد بناء جيل من الأسلحة المستقلة

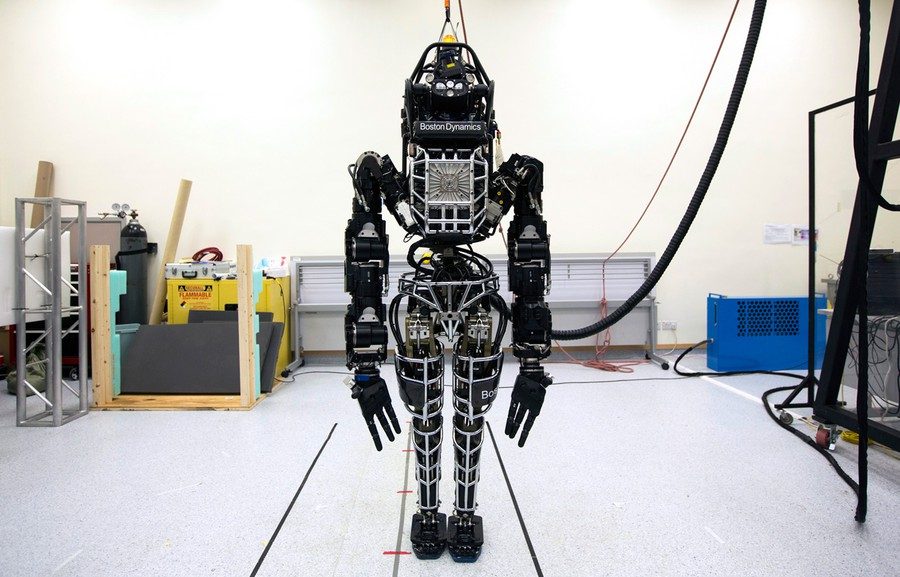

يعمل الجيش الأمريكي جاهداً مثل غيره من جيوش القوى المتقدمة على إنشاء مجموعة كاملة من أنظمة الأسلحة "المستقلة" الموجهة ذاتياً، التي تمثل أسلحةً مسيّرة قتالية قادرة على استخدام القوة المميتة باستقلال عن أي ضباط بشريين يُفترض بهم قيادتها. ويصفها بعض النقاد بـ"الروبوتات القاتلة"، حيث تشمل مجموعة متنوعة من الطائرات والدبابات والسفن والغواصات "غير المأهولة" القادرة على العمل بشكلٍ مستقل.

وأثار الظهور الوشيك لتلك الآلات القاتلة حالة قلق وجدل عالمية، مع سعي بعض الدول إلى حظرها بالفعل، بينما تخطط دول أخرى لترخيص استخدامها تحت إشراف البشر فقط -ومنها الولايات المتحدة.

وفي أغلب الحالات، يدور الجدل المرتبط باستخدام هذه الأسلحة في ساحة المعركة حول ما إذا كانت ستتمتع بالقدرة على إزهاق أرواح البشر دون إشراف بشري أم لا.

وتجادل العديد من المنظمات الدينية ومنظمات المجتمع المدني بأن هذه النوعية من الأنظمة ستعجز عن التمييز بين المقاتلين وبين المدنيين داخل ساحة المعركة، لذا يجب حظرها من أجل حماية غير المقاتلين من الموت أو الإصابة كما يقتضي القانون الدولي. بينما يؤكد المسؤولون الأمريكيون من ناحيةٍ أخرى على أن هذه الأسلحة يمكن تصميمها للعمل بصورةٍ مثالية داخل إطار القيود القانونية.

ومع ذلك، لم يتطرق أي من طرفي هذا الجدال إلى الجانب الذي قد يكون الأكثر إثارةً للقلق في استخدامها داخل المعركة، وهو احتمالية أن تتمكن تلك الأسلحة من التواصل مع بعضها البعض دون تدخل بشري عاجلاً أو آجلاً، فضلاً عن احتمالية نجاحها في ابتكار تكتيكاتها الخاصة غير المخطط لها من أجل هزيمة العدو -أو فعل شيء آخر كلياً- بفضل كونها "ذكية".

وفي الوقت الراهن، سنجد أن غالبية الأسلحة المستقلة التي يطورها الجيش الأمريكي ستكون عبارةً عن نسخ غير مأهولة من المنصات القتالية القائمة بالفعل، وسيجري تصميمها للعمل إلى جانب نظيراتها المأهولة.

أمريكا تريد بناء أسراب من "الروبوتات" لمواجهة تفوق الصين العددي

لكن بعض الخبراء الاستراتيجيين الأمريكيين يدعمون نهجاً بديلاً لاستخدام الأسلحة المستقلة في ساحات المعارك المستقبلية. ولن تلعب تلك الأسلحة دور الزميل الأصغر داخل الفرق التي يقودها البشر بموجب ذلك النهج، بل ستتحول إلى أعضاء سواسية داخل أسراب روبوتية ذاتية التوجيه.

وستتألف بعض التشكيلات من عشرات وربما مئات الطائرات المسيّرة، أو الزوارق البحرية المسيرة، أو العربات البرية غير المأهولة. وستصبح جميعها قادرةً على التواصل معاً، ومشاركة البيانات حول ظروف ساحة المعركة المتغيرة، وتعديل تكتيكاتها القتالية بموجب ما يراه العقل الجمعي ضرورياً.

إذ تنبأ بذلك بول شار، أحد أوائل المتحمسين لهذا المفهوم، عندما كتب في تقرير لمركز Center for a New American Security عام 2014: "ستسمح التقنيات الروبوتية الناشئة لقوات المستقبل أن تقاتل كسرب بأعداد، وتنسيق، وذكاء، وسرعة أكبر من القوات المتصلة شبكياً اليوم".

هذه الأسراب سوف تتواصل مع بعضها وتتخذ القرار بشكل جماعي

كما أوضح شار في تقريره التنبئي، فإن تحقيق مفهوم الأسراب بشكلٍ كامل سيتطلب تطوير خوارزميات متطورة تتيح للأنظمة القتالية المستقلة التواصل مع بعضها البعض، و"التصويت" على أنماط الهجوم المفضلة. وأشار إلى أن هذا الأمر سيتطلب تطوير برنامج قادر على محاكاة النمل، والنحل، والذئاب، وغيرها من الكائنات التي تُظهر سلوكيات "الأسراب" في الطبيعة.

جرى تفويض الكثير من تلك الجهود لوكالة داربا الدفاعية. وأطلقت داربا برنامج "الفسيفساء" ضمن حملتها لتطوير الذكاء الاصطناعي اللازم لهذا النوع من عمليات الأسراب التعاونية. وكان البرنامج عبارة عن سلسلة مشروعات تهدف إلى صقل الخوارزميات والتقنيات اللازمة لتنسيق الأنشطة، وذلك بين الأنظمة القتالية المأهولة وغير المأهولة في سيناريو القتال المستقبلي عالي الكثافة مع روسيا و/أو الصين.

وأوضح دان بات، نائب مدير مكتب التقنية الاستراتيجية في داربا: "إن تطبيق المرونة الكبيرة لمفهوم الفسيفساء على الحرب يعني ربط الأنظمة الأقل تعقيداً وتكلفةً معاً بعدد كبير من الطرق، وذلك لخلق التأثيرات المتشابكة المرغوبة والمصممة للتعامل مع كل سيناريو على حدة. حيث يمكن الاستغناء عن أحد أجزاء الفسيفساء المنفردة، لكن الفسيفساء نفسها لا تقدر بثمن بفضل طريقة إسهامها الكلية".

ومن الواضح أن مفهوم الحرب هذا يدعم استراتيجية "المُضاعِف" التي أعلنت عنها نائبة وزير الدفاع كاثلين هيكس في الصيف الماضي. حيث قالت لمسؤولي صناعة الأسلحة في أغسطس/آب الماضي: "الهدف من استراتيجية المُضاعف هو مساعدتنا في التغلب على أكبر مزايا الصين، وهي العدد الضخم. حيث تمتلك عدداً أكبر من السفن، والصواريخ، والبشر". واقترحت أن نشر آلاف الطائرات المسيّرة، والزوارق البحرية المسيرة، والغواصات المسيّرة، والعربات البرية غير المأهولة سيُتيح للجيش الأمريكي التفوق على الجيش الصيني في الدهاء والمناورة والقوة.

ومن أجل الحصول على المعدات والبرمجيات اللازمة لتطبيق برنامجٍ طموحٍ كهذا، تسعى وزارة الدفاع الأمريكية الآن للحصول على عروض من مقاولين دفاعيين تقليديين مثل Boeing وRaytheon، بالإضافة إلى الشركات الناشئة في مجال الذكاء الاصطناعي مثل Anduril وShield AI. وربما تشمل هذه الحملة أسلحةً كبيرة الحجم مثل طائرة القتال التعاونية وغواصة أوركا المسيرة كبيرة الحجم، لكن التركيز ينصب حالياً على الإنتاج السريع للأسلحة الأصغر والأقل تعقيداً، مثل مسيّرات الشفرات المتحولة من شركة AeroVironment -والتي تستخدمها القوات الأوكرانية حالياً للقضاء على الدبابات والمدرعات الروسية خلف خطوط العدو.

وفي الوقت ذاته، دعا البنتاغون بالفعل شركات التقنية الناشئة إلى تطوير البرمجيات اللازمة لتسهيل التواصل والتنسيق، وذلك بين الوحدات الروبوتية المتباينة وبين منصاتها المأهولة المرتبطة.

الجيش الأمريكي يخطط لأن يطلق لأسراب الروبوتات حرية التخطيط والتنفيذ

يمكن القول إنها مسألة وقتٍ فقط قبل أن يصبح الجيش الأمريكي (مع الصيني والروسي وربما جيوش بعض القوى الأخرى) قادراً على نشر أسراب من أنظمة الأسلحة المستقلة، التي ستأتي مجهزة بخوارزميات تسمح لها بالتواصل في ما بينها واختيار مناورات قتالية جديدة وغير متوقعة أثناء الحركة.

وسيحصل كل عضو روبوتي مشارك في تلك الأسراب على هدف للمهمة، لكن من دون تعليمات دقيقة حول كيفية تحقيق ذلك الهدف. وسيسمح لها ذلك باختيار تكتيكات المعركة التي تناسبها بعد التشاور في ما بينها.

وإذا كنا سنأخذ ببيانات الاختبارات المحدودة الموجودة لدينا، فقد يعني هذا استخدام تكتيكات غير تقليدية تماماً ولم تخطر في بال الطيارين والقادة البشر على الإطلاق (بل يستحيل عليهم تقليدها كذلك).

ويستخدم خبراء الحاسوب مصطلح: "السلوك الناشئ" لوصف نزعة أنظمة الذكاء الاصطناعي المترابطة إلى المشاركة في نتائج جديدة وغير مخطط لها. وهذا يعني -بالمصطلحات العسكرية- أن أسراب الأسلحة المستقلة ربما تصوت جماعياً على تبني تكتيكات قتالية لم تسبق برمجة أي من أجهزتها المنفردة على تأديتها من قبل.

وهذا قد يؤدي لاتخاذها قراراً بإطلاق شكل من أشكال الدمار النووي

وقد يحقق هذا نتائج مذهلة في ساحة المعركة، أو ربما يدفعها للانخراط في أفعال تصعيدية غير مقصودة وغير متوقعة من جانب القادة البشر، وهذا يشمل تدمير البنى التحتية المدنية الحيوية أو منشآت الاتصالات المستخدمة في العمليات التقليدية والنووية.

ومن شبه المستحيل في المرحلة الحالية بالطبع أن نتنبأ بما قد يختار العقل الجماعي غير البشري أن يفعله، وذلك في حال كان مسلحاً بأسلحة متعددة ومنقطع الاتصال بالإشراف البشري.

ومن المفترض تجهيز مثل هذه الأنظمة بآليات أمان تُلزمها بالعودة إلى القاعدة حال فقدان الاتصال مع المشرفين البشر، سواء بسبب تشويش العدو أو لأي سبب آخر. لكن من يعلم كيف يمكن أن تتصرف تلك الآلات المفكرة تحت ظروف العالم الواقعي المتطلبة، أو في حال أثبت ذلك العقل الجمعي أنه قادر على تجاوز مثل تلك التوجيهات والتصرف من تلقاء نفسه.

الأمر قد لا يقتصر على سيطرة الروبوتات على العالم، فقد تهدد وجود البشرية

ويؤكد كبار المسؤولين العسكريين والدبلوماسيين الأمريكيين على إمكانية استخدام الذكاء الاصطناعي دون التعامل مع تلك المخاطر المستقبلية، وأن الدولة لن تنشر سوى الأسلحة التي تحتوي على ضمانات سلامة كافية تماماً ضد أي سوء سلوك مستقبلي خطير.

لكن العديد من مسؤولي الأمن والتقنية البارزين يدركون جيداً المخاطر المحتملة للسلوك الناشئ في الأسلحة الروبوتية المستقبلية، ويستمرون في إصدار تحذيراتهم ضد التعجيل باستخدام الذكاء الاصطناعي في الحرب.

وعندما يخبرنا كبار المدافعين عن الأسلحة المستقلة بأن هناك ما يدعو للقلق بشأن الأخطار غير المقصودة التي يشكلها استخدام تلك الأسلحة في المعركة، فلا شك أنه ينبغي علينا أن نشعر بالقلق جميعاً.

وحتى إذا كنا نفتقر إلى البراعة الرياضية لفهم "السلوك الناشئ" للذكاء الاصطناعي، فمن الواضح أن البشرية قد تواجه تهديداً كبيراً لوجودها في حال حصلت آلات القتل على قدرة التفكير بمفردها. وربما تقرر تلك الأسلحة مفاجأة الجميع وتولي مهمة حفظ السلام دولياً بما قد يفضي إلى سيطرة الروبوتات على العالم.

الأسوأ أنها مصممة للقتال والقتل، ولهذا من المرجح أن تختار تنفيذ تلك التعليمات ببساطة وبطريقة مستقلة ومتطرفة.

يقول كاتب التقرير "إذا حدث ذلك، فلن يبقى أحد منا ليكتب "ارقدوا في سلام" على ضريح البشرية".